Atualizado em 4 de maio de 2026. O DeepSeek pode ajudar empresas a reduzir custos, mas só quando é tratado como parte de uma arquitetura bem desenhada. A leitura correta hoje não é “IA gratuita para substituir processos inteiros”. A leitura correta é: o DeepSeek é um ecossistema com chat web, app, API oficial, modelos com pesos públicos em alguns releases e opções de implantação que variam conforme custo, risco, licença, privacidade, governança e infraestrutura.

Para empresas, a decisão mais importante é separar uso direto no app/web, uso via API oficial, uso via provedores gerenciados ou terceiros e execução local ou auto-hospedada. Cada caminho tem controles, custos e responsabilidades diferentes. Misturar essas camadas gera promessas imprecisas, especialmente quando o objetivo é reduzir orçamento operacional.

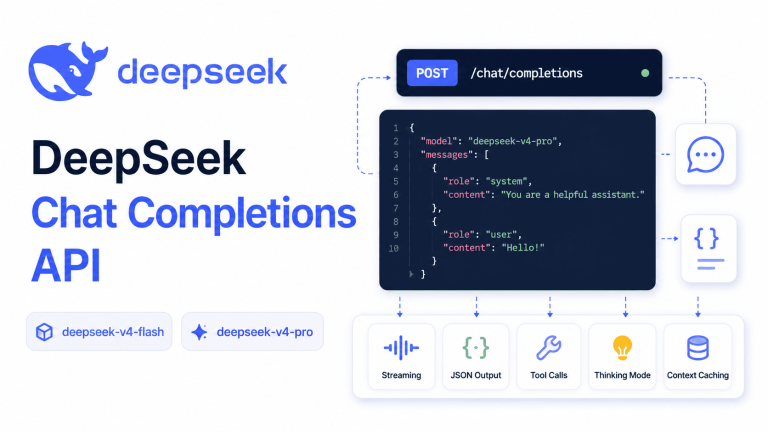

Resumo executivo: para novas integrações em 2026, use

deepseek-v4-flashquando a prioridade for velocidade, volume e custo operacional, edeepseek-v4-proquando a tarefa exigir mais raciocínio, planejamento, agentes ou análise complexa. Os nomesdeepseek-chatedeepseek-reasonerdevem aparecer apenas como aliases temporários de compatibilidade, não como recomendação principal para código novo.

Esta página foi atualizada para não publicar valores fixos de preço dentro do artigo. Como a própria documentação oficial informa que preços podem variar, o texto explica como pensar custo real e direciona o leitor para a página de preços do DeepSeek e para a tabela oficial no momento de orçamento, contrato ou produção.

O que mudou para empresas em 2026

A camada atual da API oficial da DeepSeek mudou para o ciclo DeepSeek-V4 Preview. A documentação oficial apresenta os modelos deepseek-v4-flash e deepseek-v4-pro, mantendo o base_url https://api.deepseek.com. O uso de deepseek-chat e deepseek-reasoner deve ser tratado como compatibilidade temporária: eles correspondem, respectivamente, aos modos non-thinking e thinking do deepseek-v4-flash, e estão marcados para descontinuação em 2026/07/24.

Isso muda a forma correta de orientar empresas. Uma página empresarial não deve mais dizer que a API pública atual é “DeepSeek-V3.2 com 128K”. O enquadramento correto é DeepSeek V4 para novas integrações, com V3.2, R1, Coder e outras famílias aparecendo como histórico técnico, referência de evolução ou opção específica de modelos publicados.

| Item | Como publicar agora | Por que importa para empresas |

|---|---|---|

| Modelos de API para código novo | deepseek-v4-flash e deepseek-v4-pro. | Evita começar um projeto novo com aliases que já têm data de descontinuação. |

| Aliases antigos | deepseek-chat e deepseek-reasoner apenas como compatibilidade temporária. | Reduz risco de manutenção e retrabalho em integrações corporativas. |

| Base URL | https://api.deepseek.com. | Permite manter clientes e SDKs compatíveis com formato OpenAI. |

| Contexto | 1M tokens na documentação atual da API. | Ajuda em RAG, análise documental, suporte e fluxos com políticas extensas, mas não elimina a necessidade de minimização. |

| Saída máxima | 384K na tabela oficial atual. | Útil para relatórios, documentação e agentes, mas deve ser controlada por custo, latência e qualidade. |

| Recursos | JSON Output, Tool Calls, Thinking Mode, Context Caching e compatibilidade com OpenAI Chat Completions. | Permite encaixar o modelo em fluxos empresariais estruturados, não apenas em chat livre. |

O que o DeepSeek representa hoje para empresas

Em ambiente corporativo, o DeepSeek não deve ser descrito como um produto único. Ele pode aparecer em quatro camadas diferentes:

- Chat web e app: úteis para uso individual, teste rápido e produtividade pontual, mas não substituem uma arquitetura empresarial com controle de acesso, logs, auditoria e integração.

- API oficial: o caminho mais direto para integrar DeepSeek a produtos, backends, fluxos de atendimento, RAG, agentes e automações internas.

- Provedores gerenciados ou terceiros: podem simplificar implantação, billing, infraestrutura ou governança, mas cada provedor tem model IDs, limites, regiões, políticas e preços próprios.

- Auto-hospedagem: possível em releases com pesos públicos, desde que a licença do modelo específico permita e a empresa tenha infraestrutura, equipe, monitoramento e governança.

A API oficial é o melhor primeiro passo para a maioria das empresas porque reduz fricção, permite validar valor rapidamente e evita investir em infraestrutura antes de medir impacto. Auto-hospedagem pode fazer sentido, mas não deve ser vendida como custo zero: ela transfere custo para GPU, energia, armazenamento, deploy, monitoramento, segurança, engenharia, incidentes e atualização.

Onde o DeepSeek pode reduzir custos de verdade

O DeepSeek reduz custo quando entra em tarefas repetitivas, mensuráveis e bem delimitadas. Ele não reduz custo quando é usado como substituto genérico de processo, base de dados, equipe, governança ou revisão humana.

| Cenário empresarial | Onde o custo pode cair | O que ainda custa | Indicador para medir |

|---|---|---|---|

| Atendimento ao cliente | Rascunho de respostas, resumo de tickets, classificação de intenção e triagem inicial. | Integração com helpdesk, revisão humana, regras de negócio, atualização de políticas e monitoramento de qualidade. | Tempo médio de resposta, taxa de resolução, taxa de escalonamento e satisfação do cliente. |

| Base de conhecimento interna | Menos tempo procurando políticas, manuais, procedimentos e documentação dispersa. | RAG, busca, banco vetorial, controle de acesso, versionamento, ingestão de documentos e auditoria. | Tempo para localizar resposta, taxa de resposta com fonte e número de tickets internos evitados. |

| Relatórios e resumos | Primeiras versões de atas, relatórios, sínteses executivas e documentação de reuniões. | Validação factual, revisão editorial, aprovação executiva e segurança de dados. | Horas economizadas por relatório e porcentagem de texto aproveitado após revisão. |

| Triagem operacional | Classificação de solicitações, encaminhamento inicial, priorização e padronização de linguagem. | Definição de categorias, testes, fallback, correção de erro e integração com sistemas internos. | Taxa de classificação correta, retrabalho e tempo de fila. |

| Programação e automação técnica | Geração de scripts, revisão de logs, explicação de erros, documentação técnica e snippets. | Revisão de código, testes, segurança, CI/CD e responsabilidade do desenvolvedor. | Tempo de resolução, bugs evitados, tempo de onboarding e qualidade do código revisado. |

| Marketing e vendas | Rascunhos de e-mails, resumos de leads, variações de copy, análise de feedback e propostas iniciais. | Aprovação de marca, revisão comercial, checagem de dados, compliance e personalização final. | Tempo por proposta, taxa de resposta, consistência de tom e retrabalho. |

O critério mais saudável é simples: se a IA acelera uma etapa intermediária e o fluxo final fica mais rápido, consistente e auditável, existe potencial real de economia. Se a IA apenas gera mais conteúdo para revisar, mais exceções para corrigir ou mais risco para controlar, o custo pode apenas mudar de lugar.

API oficial, provedor gerenciado ou auto-hospedagem?

Empresas não precisam escolher uma única estratégia para sempre. Um caminho comum é começar pela API oficial, medir valor em um fluxo pequeno, depois decidir se uma oferta gerenciada de terceiro ou uma implantação local faz sentido.

| Caminho | Quando faz sentido | Vantagens | Riscos e custos |

|---|---|---|---|

| API oficial DeepSeek | Validação rápida, produto SaaS, automação interna, atendimento, RAG e fluxos com backend próprio. | Menor tempo de implementação, compatibilidade com formato OpenAI, acesso direto aos modelos atuais da API e menos infraestrutura inicial. | Dependência da API oficial, política de dados do provedor, gestão de chaves, limites, latência, orçamento por uso e governança de contexto. |

| Provedor gerenciado ou terceiro | Empresas que querem billing, infraestrutura, suporte ou governança dentro de um provedor já usado. | Mais conveniência operacional e possível integração com controles existentes. | Disponibilidade, model IDs, recursos, preços, regiões e políticas podem diferir da API oficial. |

| Auto-hospedagem | Controle forte, política interna rígida, grande volume, pesquisa, customização técnica ou requisitos específicos de infraestrutura. | Mais controle potencial, menor dependência direta de APIs externas e possibilidade de operar pesos públicos quando a licença permitir. | GPU, energia, equipe, observabilidade, segurança, atualização, quantização, incidentes, avaliação contínua e revisão de licença. |

Auto-hospedagem não significa “custo zero”. Ela remove ou reduz a fatura de tokens de um provedor, mas transfere custo para infraestrutura e operação. Para algumas empresas, essa troca compensa. Para outras, a API oficial ou uma oferta gerenciada será mais barata e segura na prática.

Licença e pesos públicos: como escrever sem exagerar

Também é importante não tratar licença como slogan. O model card da série DeepSeek V4 no Hugging Face apresenta V4-Pro e V4-Flash como modelos com contexto de 1M, e informa licença MIT para o repositório e os pesos do modelo. Isso é relevante para pesquisa, auto-hospedagem e implantação local, mas não autoriza dizer que todo o ecossistema DeepSeek tem sempre a mesma licença.

Para uso comercial, redistribuição, fine-tuning, hospedagem local ou modelos derivados, verifique sempre o model card e a licença da versão específica. Além disso, o uso via API é governado pelos Termos da Open Platform, não pela licença do repositório open-weight.

Recursos da API que importam para empresas

A DeepSeek API usa formato compatível com OpenAI. Isso facilita testes para equipes que já trabalham com SDKs, clientes e padrões próximos à API da OpenAI. O base_url oficial é https://api.deepseek.com; para código novo, o parâmetro model deve usar deepseek-v4-flash ou deepseek-v4-pro.

| Recurso | Por que importa em empresa | Como usar com cuidado |

|---|---|---|

| Contexto de 1M | Permite trabalhar com políticas, documentação, histórico e trechos recuperados em fluxos de atendimento, análise e RAG. | Não envie tudo sempre. Recupere apenas o contexto necessário para reduzir custo, risco e ruído. |

| JSON Output | Ajuda a devolver respostas estruturadas para CRMs, ERPs, bancos de dados, automações e validação de campos. | Use response_format, peça JSON no prompt, dê exemplo do formato e valide o resultado no backend. |

| Tool Calls | Permite que o modelo solicite chamadas a ferramentas, como busca, CRM, cálculo, catálogo, calendário ou sistema interno. | O modelo não executa a ferramenta sozinho. A aplicação precisa executar, validar e registrar a ação. |

| Thinking Mode | Útil para análise mais complexa, planejamento, raciocínio e tarefas multi-etapas. | Não use como padrão para tudo. Reserve para tarefas em que raciocínio adicional gere valor mensurável. |

| Multi-round stateless | A API não mantém memória invisível da conversa; a aplicação decide qual histórico reenviar. | Implemente política clara de retenção, truncamento, minimização de dados e custo por conversa. |

| Context Caching | Cache de prefixos repetidos pode reduzir custo quando há instruções, políticas ou documentos recorrentes. | Padronize prompts e blocos fixos, mas trate cache como otimização de melhor esforço, não como garantia. |

Um erro comum em empresas é usar o modelo como se fosse um sistema autônomo. Tool Calls, por exemplo, são úteis porque o modelo pode indicar qual função chamar e com quais argumentos. Mas a execução real continua sendo responsabilidade do sistema: validar permissões, chamar a API interna, checar resultado, registrar logs e decidir se a resposta pode ser exibida ao usuário.

Exemplo simples de chamada à API para um fluxo empresarial

O exemplo abaixo mostra uma chamada básica usando o SDK da OpenAI com a base_url da DeepSeek. Em produção, a chave deve ficar no backend, nunca no navegador, app público ou código client-side.

from openai import OpenAI

import os

client = OpenAI(

api_key=os.environ["DEEPSEEK_API_KEY"],

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{

"role": "system",

"content": (

"Você é um assistente empresarial. Responda em português do Brasil, "

"use apenas o contexto fornecido e encaminhe para revisão humana "

"quando faltar informação."

)

},

{

"role": "user",

"content": "Resuma este ticket e sugira a próxima ação para o time de suporte."

}

],

extra_body={"thinking": {"type": "disabled"}}

)

print(response.choices[0].message.content)Para tarefas mais complexas, como análise de risco, planejamento de projeto, investigação técnica ou comparação de políticas, troque para deepseek-v4-pro e habilite Thinking Mode conforme a documentação oficial. Em Thinking Mode, não trate parâmetros como temperature e top_p como controles efetivos, porque a documentação informa que eles não têm efeito nesse modo.

Preço, cache e orçamento real sem números fixos

Esta página não publica valores fixos de preço porque esse dado pode mudar. A forma segura de escrever sobre custo empresarial é explicar os vetores que determinam orçamento e direcionar o leitor para a tabela oficial e para a página interna de preços do DeepSeek.

Em produção, o custo real depende de:

- quantidade média de tokens por chamada;

- número de chamadas por usuário, ticket, tarefa ou agente;

- proporção entre tokens de entrada e saída;

- uso de cache hit em prompts e contextos repetidos;

- escolha entre

deepseek-v4-flashedeepseek-v4-pro; - uso de Thinking Mode em tarefas simples ou complexas;

- retries, erros, chamadas duplicadas e loops de agente;

- qualidade do RAG e tamanho do contexto recuperado;

- latência aceitável e necessidade de streaming;

- custos de revisão humana, segurança, logs e manutenção.

Uma forma simples de começar é medir cada fluxo com quatro números internos: custo médio por execução, tempo humano economizado, taxa de erro e impacto no resultado de negócio. Se um bot reduz tokens, mas aumenta retrabalho humano, o projeto não reduziu custo real.

Como usar cache para reduzir custo

O Context Caching da DeepSeek é habilitado por padrão. Quando chamadas posteriores têm prefixos sobrepostos com chamadas anteriores, a parte repetida pode ser contabilizada como cache hit. Isso favorece arquiteturas em que a empresa padroniza partes do prompt.

Boas candidatas a cache hit incluem:

- instruções de sistema estáveis;

- políticas de atendimento usadas em vários tickets;

- guias de tom e estilo da marca;

- regras de classificação repetidas;

- catálogos, FAQs ou blocos documentais recorrentes;

- templates de resposta e critérios de validação.

Más candidatas incluem prompts montados de forma imprevisível, documentos enviados em ordem diferente a cada chamada, histórico excessivo e contexto recuperado sem padronização. Em projetos empresariais, engenharia de prompt e engenharia de custo caminham juntas.

Casos de uso empresariais recomendados

1. Atendimento ao cliente e help center

O DeepSeek pode ajudar a resumir tickets, identificar intenção, sugerir resposta inicial, adaptar tom, encontrar política relevante e preparar artigos de ajuda a partir de dúvidas recorrentes.

Não automatize tudo no primeiro dia. Comece com modo assistido: o modelo sugere, o agente revisa. Depois, automatize apenas respostas de baixo risco e alta repetição, como status de pedido, política de troca padronizada ou perguntas de onboarding.

KPIs úteis: tempo médio de atendimento, taxa de primeira resposta, taxa de escalonamento, retrabalho, satisfação e porcentagem de respostas aceitas sem edição.

2. Base de conhecimento interna com RAG

Em vez de esperar que o modelo “saiba” tudo sobre a empresa, use RAG: a aplicação busca trechos autorizados em documentos internos e envia apenas o contexto necessário para a geração final. Isso reduz alucinação, melhora rastreabilidade e ajuda a controlar acesso por documento.

Para esse cenário, o modelo não substitui a base de conhecimento. Ele atua como camada de síntese, explicação e resposta. O trabalho crítico está em ingestão de documentos, metadados, permissões, versionamento e recuperação de trechos relevantes.

Veja também o guia do site sobre bases de conhecimento com DeepSeek.

3. Relatórios, atas e resumos executivos

DeepSeek pode transformar notas dispersas em primeira versão de relatório, resumir reuniões, organizar decisões, extrair riscos, listar próximos passos e adaptar o mesmo conteúdo para públicos diferentes.

O ganho real aparece quando o time economiza tempo na preparação. O documento final ainda precisa de revisão humana, especialmente quando envolve decisões financeiras, jurídicas, regulatórias, médicas, contratação, demissão, segurança ou comunicação pública.

4. Triagem de solicitações internas

Departamentos como RH, financeiro, jurídico, suporte de TI e operações recebem muitas solicitações repetitivas. O DeepSeek pode classificar, resumir, sugerir prioridade, extrair campos e encaminhar para a fila correta.

O ideal é usar classes bem definidas e medir erro por categoria. Se uma classificação incorreta pode causar dano relevante, mantenha revisão humana ou fallback conservador.

5. Programação, DevOps e suporte técnico

Times técnicos podem usar DeepSeek para explicar erros, gerar scripts, documentar APIs, resumir logs, revisar trechos de código e criar checklists de incidentes. O valor está em acelerar tarefas intermediárias, não em aceitar código sem teste.

Em produção, trate saídas de código como rascunho: aplique lint, testes, revisão de segurança, CI/CD e aprovação de desenvolvedor. Para fluxos com ferramentas, valide permissões antes de permitir qualquer ação em sistemas reais.

6. Vendas, propostas e atendimento comercial

DeepSeek pode resumir conversas com leads, preparar e-mails, extrair objeções, adaptar propostas, gerar follow-ups e criar variações de mensagem por segmento.

O cuidado principal é factualidade. Preços, condições comerciais, disponibilidade de produto, desconto e contrato devem vir de sistemas internos confiáveis, não da memória do modelo.

7. Operações, compras e processos internos

O modelo pode comparar fornecedores, resumir documentos de compra, organizar requisitos, transformar políticas em checklists e preparar análises preliminares.

Em compras, jurídico e compliance, a IA deve acelerar leitura e organização, não substituir aprovação formal. Use fontes citáveis, logs e critérios claros de decisão.

Onde o DeepSeek não deve ser usado sozinho

O DeepSeek não deve tomar decisões autônomas em contextos críticos sem validação humana, testes e governança. Evite uso direto e sem supervisão em:

- decisões médicas, jurídicas, financeiras ou de crédito;

- contratação, demissão, avaliação de desempenho ou decisões sobre pessoas;

- aprovação de pagamentos, contratos, reembolsos ou descontos relevantes;

- ações que alterem sistemas de produção sem aprovação;

- respostas públicas em crises, incidentes de segurança ou temas regulatórios;

- processamento de dados sensíveis sem base legal, minimização e controles.

A regra editorial e operacional deve ser clara: quanto maior o risco, mais o DeepSeek deve atuar como copiloto de preparação e menos como agente autônomo.

Privacidade, dados e compliance

Para empresas, privacidade não é detalhe. A política oficial da DeepSeek informa que os serviços podem coletar inputs do usuário, incluindo texto, voz, prompts, arquivos enviados, fotos, feedback, histórico de chat e outros conteúdos fornecidos ao modelo. A política também afirma que os serviços não foram desenhados para processar dados sensíveis, como saúde, origem étnica, religião, sexualidade, dados de crianças, biometria, geolocalização precisa ou dados criminais.

A mesma política informa que dados pessoais coletados podem ser armazenados fora do país do usuário e que, para fornecer os serviços, a DeepSeek coleta, processa e armazena dados pessoais na República Popular da China. Para empresas brasileiras, europeias ou multinacionais, isso deve entrar na avaliação de risco, LGPD/GDPR, política interna e revisão jurídica.

Ao usar a API oficial, a empresa também precisa lembrar que a política de privacidade da DeepSeek declara que regras de processamento para dados de usuários finais em aplicações desenvolvidas por terceiros não são cobertas por aquela política da mesma forma: o desenvolvedor da aplicação é controlador do tratamento e deve divulgar sua própria política aos usuários finais.

Boas práticas mínimas:

- não enviar dados sensíveis quando não houver base legal e necessidade clara;

- minimizar prompts e contexto;

- remover ou mascarar dados pessoais sempre que possível;

- usar backend próprio em vez de expor chave de API no front-end;

- registrar apenas logs necessários;

- controlar quem pode consultar cada documento interno;

- separar ambientes de teste e produção;

- validar respostas antes de ações de alto impacto;

- manter política clara para retenção, auditoria e incidentes.

Para alinhar essa parte ao restante do site, veja também a página de segurança e privacidade.

Roteiro prático de implantação

Etapa 1: escolha um fluxo pequeno e mensurável

Não comece com “usar IA na empresa inteira”. Comece com um fluxo: resumo de tickets, rascunho de resposta, triagem de chamados, geração de FAQ, classificação de e-mails ou síntese de documentos internos. O fluxo deve ter volume, repetição e métrica clara.

Etapa 2: defina o que pode e o que não pode entrar no prompt

Liste dados proibidos, dados permitidos, regras de mascaramento, fontes autorizadas e condições de revisão humana. Essa etapa evita que o projeto vire um risco de privacidade.

Etapa 3: escolha o modelo por tarefa

Use deepseek-v4-flash como ponto de partida para alto volume, triagem, resumos e tarefas repetitivas. Use deepseek-v4-pro quando a tarefa exigir planejamento, raciocínio, análise multi-etapas, agentes ou validação mais cuidadosa.

Etapa 4: construa contexto confiável

Para atendimento e base de conhecimento, a qualidade do RAG costuma importar mais que o modelo. Organize documentos, metadados, permissões, versões e fontes antes de escalar.

Etapa 5: comece com humano no loop

Durante a validação, o modelo deve sugerir e o humano aprovar. Registre quando a sugestão foi aceita, editada ou rejeitada. Esse feedback revela se o fluxo reduz custo de verdade.

Etapa 6: monitore custo, qualidade e risco

Crie painéis simples: tokens por chamada, custo por tarefa, taxa de erro, taxa de resposta aceita, latência, falhas, escalonamento e incidentes. Sem métricas, a empresa só terá sensação de produtividade.

Etapa 7: automatize apenas o que é seguro

Depois de medir, automatize categorias de baixo risco e mantenha revisão humana para exceções, reclamações, casos sensíveis, pedidos fora de política e qualquer cenário com impacto financeiro, jurídico ou reputacional.

Modelo simples de ROI para DeepSeek

Para avaliar se o DeepSeek reduz custo, use uma conta simples:

Economia real = tempo humano economizado + aumento de qualidade + redução de retrabalho − custo de tokens − custo de integração − custo de revisão − custo de manutenção − custo de risco.

Em vez de medir apenas “custo por token”, acompanhe indicadores de negócio:

- custo por ticket resolvido;

- tempo médio por solicitação;

- porcentagem de sugestões aceitas;

- número de documentos consultados por atendimento;

- taxa de resposta com fonte;

- retrabalho gerado por resposta incorreta;

- uso de cache hit vs cache miss;

- tokens desperdiçados por contexto excessivo;

- incidentes de privacidade ou segurança;

- tempo de engenharia para manter o fluxo.

Um projeto de IA empresarial só é barato quando o processo inteiro fica mais eficiente. Token barato com fluxo ruim continua sendo custo ruim.

Recomendação por perfil de empresa

| Perfil | Melhor caminho inicial | Foco recomendado |

|---|---|---|

| Startup ou SaaS pequeno | API oficial | Automação de suporte, onboarding, geração de conteúdo, RAG leve e classificação. |

| Empresa de médio porte | API oficial com backend, logs e governança | Helpdesk, base interna, relatórios, triagem e padronização de processos. |

| Empresa já madura em cloud | API oficial, provedor gerenciado ou arquitetura híbrida | Integração com IAM, guardrails, observabilidade, billing e segurança já existentes. |

| Setor regulado | Avaliação jurídica antes da arquitetura | Minimização de dados, revisão humana, retenção, auditoria e possível auto-hospedagem. |

| Time técnico avançado | API oficial para validar; auto-hospedagem se houver motivo real | Comparar custo total, latência, controle, segurança e esforço de operação. |

| Equipe sem engenharia interna | Ferramenta pronta ou integrador | Evitar construir plataforma própria sem capacidade de manter segurança e qualidade. |

Erros comuns ao usar DeepSeek para reduzir custos

- Dizer que DeepSeek é sempre gratuito. O chat/app pode ter acesso gratuito conforme condições oficiais, mas API, integrações e auto-hospedagem têm custos reais.

- Usar aliases antigos em código novo.

deepseek-chatedeepseek-reasonerdevem ser tratados como compatibilidade temporária, não como recomendação principal. - Chamar todo o ecossistema de open-source sem explicar a versão. Licenças variam por release; verifique o model card.

- Usar Thinking Mode para tudo. Nem toda tarefa precisa de raciocínio avançado. Muitas tarefas operacionais funcionam melhor com respostas diretas e menor complexidade.

- Enviar contexto demais. Contexto longo ajuda, mas aumenta custo, latência e risco. Recupere apenas o necessário.

- Ignorar cache. Prompts estáveis e prefixos repetidos podem melhorar o custo quando bem estruturados.

- Deixar a IA agir sem permissão. Tool Calls precisam de validação, controle de acesso e logs.

- Confundir App/Web com API. A experiência no chat oficial não substitui teste real da API em produção.

- Medir só benchmark. Produção exige custo, latência, segurança, avaliação, logs e qualidade em dados reais.

- Ignorar privacidade. Dados pessoais e sensíveis exigem política, base legal, minimização e revisão.

Perguntas frequentes

DeepSeek reduz custos em empresas?

Sim, pode reduzir custos quando aplicado a tarefas repetitivas, mensuráveis e bem delimitadas, como resumo de tickets, triagem, rascunho de respostas, RAG e documentação. Mas o custo real inclui integração, revisão humana, segurança, logs, manutenção e governança.

A API do DeepSeek é gratuita?

Não trate a API como gratuita. Ela é cobrada por uso conforme a tabela oficial vigente. Para evitar informação desatualizada, esta página não publica valores fixos e direciona o leitor para a página de preços no momento de orçamento ou produção.

Qual modelo usar em empresas: deepseek-v4-flash ou deepseek-v4-pro?

Use deepseek-v4-flash para tarefas diretas, alto volume, classificação, resumo, transformação textual e atendimento assistido. Use deepseek-v4-pro quando a tarefa exigir raciocínio mais profundo, planejamento, análise multi-etapas, agentes ou depuração complexa.

Ainda posso usar deepseek-chat e deepseek-reasoner?

Eles podem funcionar como aliases de compatibilidade, mas não são a melhor recomendação para código novo. A documentação atual indica que deepseek-chat e deepseek-reasoner correspondem aos modos non-thinking e thinking do deepseek-v4-flash e estão marcados para descontinuação em 2026/07/24.

DeepSeek suporta Tool Calls?

Sim. Tool Calls permitem que o modelo solicite funções externas, mas a aplicação é responsável por fornecer e executar essas funções. O modelo não consulta CRM, banco de dados ou sistema interno sozinho.

O Context Caching reduz custo?

Pode reduzir. O Context Caching é habilitado por padrão e aproveita prefixos repetidos entre chamadas. Para tirar proveito, padronize instruções de sistema, políticas, templates e blocos documentais recorrentes. Trate cache como otimização de melhor esforço, não como garantia.

Empresas podem rodar DeepSeek localmente?

Em alguns releases com pesos públicos, sim, desde que a licença do modelo específico permita e a empresa tenha infraestrutura adequada. Auto-hospedagem não é grátis: exige GPU, energia, deploy, observabilidade, segurança, atualização e equipe técnica.

DeepSeek é seguro para dados sensíveis?

Não trate como seguro por padrão. A política oficial informa que os serviços não são destinados a processar dados sensíveis e que dados pessoais podem ser processados e armazenados na República Popular da China. Empresas devem aplicar minimização, revisão jurídica, controle de acesso e políticas internas antes de usar com dados sensíveis.

DeepSeek substitui funcionários?

O uso mais responsável é como copiloto de processos: resumir, classificar, sugerir, organizar e acelerar tarefas. Em áreas de risco, pessoas continuam responsáveis por aprovação, validação, decisão e comunicação final.

Qual é o primeiro caso de uso recomendado?

Comece com um fluxo de baixo risco e alto volume, como resumo de tickets, rascunho de resposta de suporte, classificação de solicitações ou FAQ interna com RAG. Meça tempo economizado, taxa de erro, custo por tarefa e retrabalho.

Conclusão

O DeepSeek pode ser uma ferramenta poderosa para empresas em 2026, especialmente em fluxos de alto volume, atendimento, RAG, automação, classificação, programação e documentação. Mas a economia real não vem apenas de preço por token. Ela vem de uma arquitetura bem desenhada: contexto certo, cache, revisão humana, controle de acesso, medição de qualidade e governança de dados.

Para a maioria das empresas, o caminho mais seguro é começar pela API oficial com deepseek-v4-flash ou deepseek-v4-pro, medir valor em um fluxo pequeno e só depois decidir se provedor gerenciado ou auto-hospedagem fazem sentido. Auto-hospedagem pode ampliar controle, mas também amplia responsabilidade. API barata pode reduzir custo, mas só quando o processo inteiro fica melhor.

O melhor resumo é: use DeepSeek para reduzir atrito operacional, não para terceirizar decisões críticas. Quando usado com limites claros, dados bem controlados e métricas de negócio, ele pode diminuir tempo, padronizar respostas, acelerar documentação e tornar processos internos mais eficientes.