Atualizado em 4 de maio de 2026. A inteligência artificial já faz parte do atendimento ao cliente em empresas que precisam responder mais rápido, reduzir tarefas repetitivas e manter qualidade em canais como chat do site, WhatsApp, e-mail, CRM e helpdesk. Nesse contexto, o DeepSeek AI pode ser usado como uma camada de automação e apoio para equipes de suporte, desde que seja implementado com expectativas corretas sobre API, privacidade, memória de conversa, custos operacionais e revisão humana.

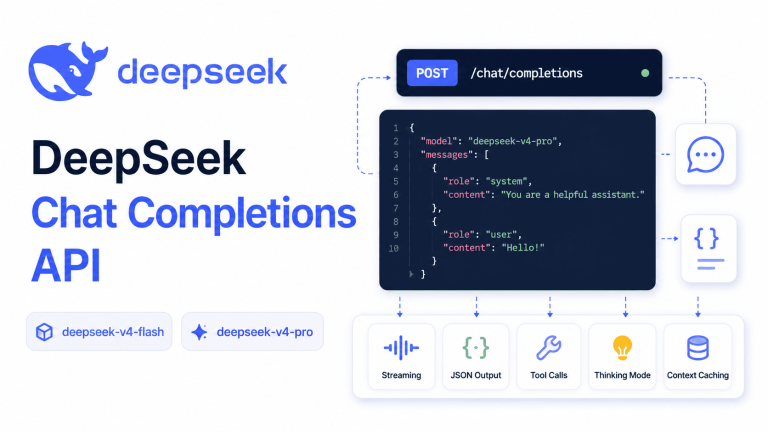

Este guia mostra como usar o DeepSeek no atendimento ao cliente de forma prática, segura e alinhada às informações oficiais atuais. Para novas integrações, o caminho recomendado é usar deepseek-v4-flash ou deepseek-v4-pro, deixando deepseek-chat e deepseek-reasoner apenas como aliases antigos de compatibilidade.

Resumo rápido: para atendimento ao cliente em 2026, use

deepseek-v4-flashem FAQ, triagem, rascunhos, classificação e automações de alto volume. Usedeepseek-v4-proquando o caso exigir raciocínio mais cuidadoso, análise de regras, diagnóstico técnico, exceções comerciais ou fluxos com maior impacto. A API continua usandobase_url="https://api.deepseek.com"e o endpoint principal/chat/completions. A API é stateless: sua aplicação precisa armazenar e reenviar o contexto necessário a cada chamada.

O que é atendimento ao cliente com DeepSeek AI?

Atendimento ao cliente com DeepSeek AI é o uso de modelos de linguagem para ajudar uma empresa a interpretar mensagens, gerar respostas, classificar tickets, resumir conversas, consultar sistemas internos por meio de ferramentas e apoiar atendentes humanos em decisões do dia a dia.

Na prática, o DeepSeek pode ser integrado a um sistema de atendimento para:

- responder perguntas frequentes com base em uma base de conhecimento aprovada;

- gerar rascunhos de resposta para e-mails, chats e tickets;

- classificar mensagens por assunto, urgência, departamento, idioma e sentimento provável;

- resumir conversas longas antes de transferir para um atendente humano;

- consultar sistemas externos, como CRM, status de pedido ou base de conhecimento, por meio de Tool Calls implementadas pelo backend;

- padronizar tom de voz, idioma, estrutura e critérios de escalonamento.

O ponto mais importante é que o DeepSeek deve atuar como uma camada de apoio dentro de um fluxo bem desenhado. Ele não substitui políticas de atendimento, base de conhecimento, revisão humana, controles de privacidade, autenticação do cliente ou integração correta com os sistemas da empresa.

Informações oficiais atuais da DeepSeek API

Antes de implementar qualquer automação de suporte, é essencial diferenciar o app/web do DeepSeek da API oficial. A experiência no app e no site oficial pode mudar sem ser idêntica à API usada em produção. Para integração técnica, a referência deve ser a documentação oficial da DeepSeek API, não testes visuais no chat público.

| Item | Informação correta para publicar |

|---|---|

| Base URL | https://api.deepseek.com |

| Endpoint principal | /chat/completions |

| Modelos para código novo | deepseek-v4-flash e deepseek-v4-pro. |

deepseek-v4-flash | Modelo indicado para velocidade, alto volume, FAQ, triagem, classificação, resumos curtos e automações de atendimento de primeiro nível. |

deepseek-v4-pro | Modelo indicado para tarefas mais exigentes, análise de regras, exceções, diagnóstico técnico, raciocínio multi-etapas e fluxos de maior impacto. |

| Thinking Mode | Controlado pelo parâmetro thinking, com esforço de raciocínio em reasoning_effort quando aplicável. |

| Contexto | 1M tokens nos modelos V4 atuais documentados oficialmente. |

| Saída máxima | Máximo documentado de 384K tokens. |

| Aliases antigos | deepseek-chat e deepseek-reasoner devem ser tratados como aliases de compatibilidade para deepseek-v4-flash, não como recomendação principal para novas integrações. |

| Recursos úteis para suporte | JSON Output, Tool Calls, Thinking Mode, multi-turn via histórico reenviado pela aplicação e Context Caching. |

| Custos | Não publique números fixos nesta página. Use a página interna de preços do DeepSeek e a tabela oficial no dia da estimativa, porque preços, descontos e regras podem mudar. |

Em novos exemplos, use diretamente deepseek-v4-flash ou deepseek-v4-pro. Mantenha deepseek-chat e deepseek-reasoner apenas como nota de compatibilidade para integrações antigas.

Quando usar deepseek-v4-flash e quando usar deepseek-v4-pro?

No atendimento ao cliente, nem toda pergunta precisa de raciocínio avançado. Escolher o modelo certo ajuda a controlar latência, previsibilidade, custo e qualidade.

| Cenário de atendimento | Modelo recomendado | Motivo |

|---|---|---|

| FAQ simples, horário de funcionamento, prazo de entrega, política de troca | deepseek-v4-flash com Thinking desabilitado | Respostas rápidas, padronizadas e de alto volume. |

| Classificação de tickets por categoria, prioridade e departamento | deepseek-v4-flash com JSON Output | A tarefa é estruturada e pode ser validada no backend. |

| Rascunho de resposta para e-mail ou chat | deepseek-v4-flash | Gera respostas úteis para revisão humana antes do envio. |

| Análise de caso com regras de contrato, histórico e exceções | deepseek-v4-pro com Thinking Mode | Exige comparação de informações, exceções e raciocínio em múltiplas etapas. |

| Diagnóstico técnico complexo ou interpretação de logs | deepseek-v4-pro | É melhor reservar o modelo mais forte para problemas difíceis. |

| Consulta a CRM, pedido, estoque ou status de entrega | deepseek-v4-flash ou deepseek-v4-pro com Tool Calls | O modelo pode solicitar uma função, mas o backend deve validar e executar a consulta real. |

Uma regra simples: comece com deepseek-v4-flash para tarefas repetitivas e use deepseek-v4-pro quando a resposta exigir análise mais profunda, alto risco de erro ou interpretação de múltiplas regras. Não use raciocínio avançado em perguntas que podem ser resolvidas por FAQ, busca interna ou regras simples.

Recursos do DeepSeek úteis para suporte ao cliente

API compatível com formato OpenAI

A DeepSeek API usa um formato compatível com Chat Completions. Isso facilita a integração em aplicações que já usam SDKs, bibliotecas ou gateways compatíveis com esse padrão. Em muitos casos, a migração técnica começa ajustando a base_url, configurando DEEPSEEK_API_KEY no backend e escolhendo deepseek-v4-flash ou deepseek-v4-pro.

Compatibilidade de formato não significa comportamento idêntico entre fornecedores. Antes de colocar em produção, teste prompts, respostas, erros, latência, limites, streaming, Tool Calls e JSON Output no seu fluxo real.

Tool Calls para consultar sistemas externos

Tool Calls permitem que o modelo solicite a execução de uma função externa. Em atendimento ao cliente, isso é útil para consultar status de pedido, verificar disponibilidade de produto, abrir ticket, buscar dados no CRM ou acionar uma regra interna.

O limite precisa ficar claro: o modelo não executa a função sozinho. Ele gera a chamada; o seu backend valida identidade, permissão e parâmetros, consulta o sistema real e devolve o resultado ao modelo para compor a resposta final. Ações irreversíveis, como cancelar pedido, emitir reembolso, alterar contrato ou apagar dados, devem exigir confirmação e controle humano.

JSON Output para respostas estruturadas

Quando você precisa classificar tickets, extrair campos de uma mensagem ou enviar dados para outro sistema, JSON Output ajuda a receber uma resposta estruturada. Exemplos de campos úteis em suporte:

{

"categoria": "entrega",

"prioridade": "alta",

"sentimento": "frustrado",

"precisa_humano": true,

"resumo": "Cliente relata atraso em pedido já pago."

}Para funcionar bem, o prompt deve pedir explicitamente JSON, mostrar o formato esperado e limitar campos possíveis. Depois, o seu sistema precisa validar o JSON antes de usar o resultado em produção.

Thinking Mode para casos complexos

Thinking Mode pode melhorar respostas em tarefas que exigem várias etapas, como comparar regras de garantia, interpretar um histórico de reclamações ou explicar um problema técnico. Na API atual, esse comportamento pode ser controlado por thinking e reasoning_effort, especialmente com deepseek-v4-pro.

Há um detalhe técnico importante: em Thinking Mode, parâmetros como temperature, top_p, presence_penalty e frequency_penalty não têm efeito. Portanto, não copie recomendações genéricas de temperatura para todos os fluxos. Ajuste o comportamento usando instruções, contexto, validação e escolha correta do modelo.

Contexto longo sem mandar tudo sempre

O contexto de 1M tokens permite trabalhar com conversas longas, trechos de documentação, políticas internas e históricos de casos. Isso é útil para suporte, mas não significa que você deve enviar tudo em todas as chamadas. Quanto maior o contexto, maior a complexidade, o custo operacional e o risco de expor dados desnecessários.

O ideal é usar uma base de conhecimento com busca, filtros por assunto e permissões por usuário, enviando ao modelo apenas os trechos relevantes para aquela pergunta. Essa abordagem reduz ruído, melhora precisão e ajuda a cumprir princípios de minimização de dados.

API stateless e memória controlada pelo backend

A API /chat/completions é stateless. Isso significa que o servidor não guarda automaticamente o histórico da conversa entre chamadas. Para criar atendimento multi-turno, sua aplicação precisa armazenar o histórico necessário, aplicar retenção, mascarar dados quando possível e reenviar ao modelo somente o contexto relevante.

Essa diferença é essencial para atendimento: “memória” não é algo que a API resolve sozinha. Ela depende do seu CRM, banco de conversas, política de retenção, consentimento, segurança e lógica de contexto.

Casos de uso práticos no atendimento ao cliente

1. Chatbot no site, WhatsApp ou app

O DeepSeek pode alimentar um chatbot para responder dúvidas frequentes, orientar o usuário, coletar dados iniciais e encaminhar casos mais complexos para um atendente humano.

Um fluxo seguro funciona assim: o cliente envia a pergunta, o backend valida a origem, remove dados desnecessários, busca trechos relevantes da base de conhecimento, chama a API do DeepSeek e aplica filtros antes de exibir a resposta. Se a pergunta envolver cancelamento, cobrança sensível, dados pessoais, reclamação grave, tema jurídico ou incerteza alta, o sistema deve transferir para um humano.

2. Rascunhos de e-mail para atendentes

No suporte por e-mail, o DeepSeek pode gerar uma primeira versão de resposta. A IA analisa a mensagem do cliente, identifica o problema e produz um rascunho educado, objetivo e alinhado ao tom da empresa.

Esse uso é especialmente seguro quando a resposta passa por revisão humana antes do envio. O atendente economiza tempo, mas continua responsável por conferir dados do cliente, prazos, promessas comerciais, política de reembolso e informações sensíveis.

3. Classificação automática de tickets

Empresas que recebem muitos tickets podem usar DeepSeek para classificar mensagens por categoria, prioridade, sentimento provável e departamento responsável. Isso ajuda a reduzir filas e encaminhar rapidamente cada caso para a equipe correta.

Exemplos de categorias:

- entrega;

- pagamento;

- troca ou devolução;

- bug técnico;

- dúvida de produto;

- cancelamento;

- reclamação sensível.

Para esse caso, JSON Output é útil porque transforma uma mensagem livre em campos padronizados dentro do helpdesk. Mesmo assim, o backend deve validar a saída e aplicar regras próprias de prioridade.

4. Análise de sentimento e detecção de urgência

O DeepSeek pode analisar o tom de mensagens para identificar frustração, urgência, risco de cancelamento ou insatisfação. Essa informação pode priorizar tickets e ajudar gestores a entender padrões de reclamação.

O resultado não deve ser tratado como diagnóstico perfeito. Sentimento é uma inferência probabilística. Use a análise como sinal de apoio, não como única base para decisões relevantes.

5. Resumo de conversas longas

Quando um atendimento passa por vários agentes ou canais, o DeepSeek pode resumir o histórico em poucos pontos: problema principal, tentativas anteriores, dados confirmados, pendências e próxima ação recomendada.

Esse resumo ajuda o próximo atendente a entrar no caso sem obrigar o cliente a repetir tudo. Também melhora registros no CRM e facilita auditoria de qualidade.

6. Assistente interno para base de conhecimento

Além do chatbot externo, empresas podem criar um assistente interno para a equipe de suporte. O atendente pergunta sobre uma política, procedimento ou configuração técnica, e o sistema responde com base em documentos internos aprovados.

Esse uso costuma ser mais fácil de começar do que um chatbot 100% voltado ao cliente, porque a equipe humana continua entre a IA e o consumidor final.

7. Suporte técnico e ajuda a desenvolvedores

Empresas de software podem usar DeepSeek para explicar mensagens de erro, sugerir exemplos de integração, revisar logs enviados pelo cliente e criar respostas técnicas mais claras.

Mesmo nesse cenário, nunca envie segredos, chaves de API, senhas, dados pessoais de clientes ou código proprietário sensível sem autorização interna. Todo código gerado pela IA deve ser revisado e testado antes de chegar ao cliente ou à produção.

Exemplo de arquitetura para chatbot com DeepSeek

Uma arquitetura básica para atendimento automatizado pode seguir este fluxo:

- o cliente envia uma pergunta no site, WhatsApp, app ou portal;

- o backend autentica a origem da mensagem e aplica regras de segurança;

- o sistema remove ou mascara dados desnecessários;

- uma busca interna recupera documentos relevantes da base de conhecimento;

- o backend monta o prompt com a pergunta, regras de atendimento e trechos aprovados;

- a API do DeepSeek gera uma resposta ou solicita uma Tool Call;

- o backend valida a resposta, executa ferramentas permitidas e registra o atendimento;

- o cliente recebe a resposta ou é encaminhado para um atendente.

Esse fluxo evita dois erros comuns: enviar contexto demais para o modelo e deixar a IA responder sem base oficial. A IA deve responder com base em documentos aprovados pela empresa, não em suposições.

Exemplo simples de chamada à API

O exemplo abaixo mostra uma chamada compatível com o SDK da OpenAI, usando a base_url da DeepSeek. Em produção, a chave de API deve ficar no backend, nunca no navegador do cliente.

from openai import OpenAI

import os

client = OpenAI(

api_key=os.environ["DEEPSEEK_API_KEY"],

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{

"role": "system",

"content": (

"Você é um assistente de atendimento ao cliente. "

"Responda em português do Brasil, use apenas as informações fornecidas "

"e encaminhe para um humano quando faltar informação."

)

},

{

"role": "user",

"content": "Meu pedido está atrasado. O que posso fazer?"

}

],

extra_body={"thinking": {"type": "disabled"}},

stream=False

)

print(response.choices[0].message.content)Para conversas com múltiplas mensagens, lembre-se: a API /chat/completions é stateless. O servidor não guarda automaticamente todo o histórico. A aplicação deve reenviar o contexto necessário em cada chamada.

Exemplo de classificação de ticket em JSON

Para triagem automática, use JSON Output e valide a resposta no backend antes de criar tags, prioridades ou automações no helpdesk.

response = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{

"role": "system",

"content": "Responda apenas em json válido no formato solicitado."

},

{

"role": "user",

"content": "Classifique este ticket: 'Estou há 8 dias sem receber meu pedido e ninguém responde.'"

}

],

response_format={"type": "json_object"},

extra_body={"thinking": {"type": "disabled"}}

)

print(response.choices[0].message.content)Como implementar DeepSeek no atendimento em 8 etapas

- Escolha um caso de uso pequeno: comece com FAQ, classificação de tickets, rascunhos de e-mail ou resumo de conversas.

- Defina fontes oficiais: use políticas, manuais, páginas de ajuda e scripts aprovados. Não deixe a IA inventar regras.

- Crie regras de escalonamento: defina quando transferir para humano, como reclamações graves, risco jurídico, dados sensíveis, cancelamento ou baixa confiança.

- Proteja dados pessoais: minimize, mascare ou anonimize dados sempre que possível. Evite enviar documentos, senhas, tokens ou dados sensíveis.

- Escolha o modelo certo: use

deepseek-v4-flashpor padrão edeepseek-v4-pronos casos que realmente exigem raciocínio mais cuidadoso. - Valide respostas estruturadas: quando usar JSON Output ou Tool Calls, valide o conteúdo no backend antes de executar ações.

- Monitore qualidade e custo: acompanhe taxa de resolução, tempo médio, satisfação, uso de tokens, latência e taxa de escalonamento.

- Atualize continuamente: revise prompts, base de conhecimento, políticas comerciais, integrações e regras de segurança.

Custos do DeepSeek no atendimento ao cliente

A API oficial do DeepSeek é cobrada por tokens de entrada e saída. Isso significa que o custo depende do tamanho das perguntas, histórico enviado, documentos usados como contexto, uso de cache, tamanho das respostas e volume mensal de conversas.

Esta página não fixa valores de preço porque a própria documentação oficial indica que preços e regras podem variar. Para orçamento, contrato ou estimativa comercial, use a página de preços do DeepSeek do site e confirme a tabela oficial no mesmo dia da decisão.

Para planejar custo sem depender de números fixos, calcule:

- quantas conversas serão processadas por mês;

- qual o tamanho médio do prompt e da resposta;

- quanto histórico será reenviado em cada chamada;

- quais casos usarão

deepseek-v4-proou Thinking Mode; - quantas mensagens podem ser resolvidas por FAQ ou busca interna sem chamar o modelo;

- qual taxa de cache hit aparece no uso real.

Evite publicar comparações fixas com GPT, Claude, Gemini ou outros provedores usando preços antigos. A comparação correta deve ser feita sempre com os preços oficiais vigentes de cada fornecedor, no mesmo período e para o mesmo tipo de uso.

DeepSeek, privacidade e LGPD no suporte ao cliente

É incorreto afirmar que o uso do DeepSeek é automaticamente “100% privado” ou que garante conformidade total com LGPD. A conformidade depende da forma de uso, tipo de dado enviado, base legal, aviso de privacidade, contrato, retenção, segurança e governança da empresa.

A política oficial de privacidade da DeepSeek informa que podem ser coletados dados como entradas do usuário, prompts, arquivos enviados, fotos, feedback, histórico de chat, dados de conta, IP, identificadores de dispositivo, cookies, logs e dados de pagamento em serviços pagos. A política também informa que os serviços não são projetados para processar dados pessoais sensíveis e recomenda que usuários não forneçam esse tipo de dado.

Além disso, quando uma empresa cria uma aplicação usando a Open Platform/API, ela própria deve informar aos usuários finais como os dados serão tratados dentro dessa aplicação. Em outras palavras: se a sua empresa cria um chatbot com DeepSeek, você precisa ter sua própria política de privacidade, controles de consentimento quando aplicável e regras claras de tratamento de dados.

Boas práticas para suporte ao cliente:

- não enviar senhas, tokens, documentos pessoais, dados de saúde, dados financeiros sensíveis ou segredos comerciais sem aprovação formal;

- mascarar dados como CPF, telefone, e-mail e número de pedido quando não forem necessários;

- evitar decisões automatizadas de alto impacto sem revisão humana;

- manter logs com retenção limitada e finalidade definida;

- informar o usuário quando uma IA estiver participando do atendimento;

- consultar jurídico, DPO/encarregado ou especialista em proteção de dados antes de processar dados pessoais em escala.

DeepSeek vs. outras soluções de IA no atendimento

DeepSeek pode ser uma alternativa interessante para empresas que querem API flexível, modelos atuais com contexto longo, JSON Output, Tool Calls e integração com ferramentas próprias. Porém, a comparação com ChatGPT Enterprise, Claude, Gemini, Copilot ou outras soluções deve ser feita de forma responsável.

| Critério | Como comparar corretamente |

|---|---|

| Custo | Compare preços oficiais atuais, cache, entrada, saída, volume mensal, latência e custo de infraestrutura. |

| Qualidade | Teste com perguntas reais dos seus clientes, em português, com critérios objetivos de acerto. |

| Privacidade | Leia políticas oficiais, termos de API, retenção, localização de processamento e responsabilidades do controlador. |

| Integração | Verifique SDKs, Tool Calls, logs, autenticação, limites, status da API e facilidade de manutenção. |

| Governança | Avalie auditoria, permissões, revisão humana, contratos, suporte corporativo e requisitos regulatórios. |

Em muitos casos, a melhor solução não é escolher uma única IA para tudo. Uma empresa pode usar DeepSeek para automações de alto volume e manter outras ferramentas para tarefas específicas, contratos corporativos ou integrações já consolidadas.

Prompts úteis para atendimento com DeepSeek

A qualidade do atendimento depende muito das instruções enviadas ao modelo. Abaixo estão exemplos que podem ser adaptados ao seu negócio.

Prompt de sistema para FAQ

Você é um assistente de atendimento ao cliente da empresa [NOME].

Responda em português do Brasil, com tom educado, claro e objetivo.

Use apenas as informações fornecidas no contexto.

Se a resposta não estiver no contexto, diga que precisa encaminhar para um atendente humano.

Não invente prazos, valores, políticas, descontos ou garantias.Prompt para classificação de ticket em JSON

Classifique a mensagem do cliente e responda apenas em JSON válido.

Categorias permitidas:

["entrega", "pagamento", "troca_devolucao", "bug_tecnico", "duvida_produto", "cancelamento", "outro"]

Formato:

{

"categoria": "",

"prioridade": "baixa|media|alta",

"sentimento": "neutro|satisfeito|frustrado|irritado",

"precisa_humano": true,

"resumo": ""

}Prompt para resumo de atendimento

Resuma a conversa para o próximo atendente.

Inclua:

1. problema principal;

2. dados confirmados;

3. ações já tentadas;

4. pendências;

5. próxima ação recomendada.

Não inclua dados pessoais desnecessários.Boas práticas para evitar erros no atendimento

- Use fontes aprovadas: conecte a IA a uma base de conhecimento confiável e atualizada.

- Defina limites: deixe claro o que a IA pode e não pode prometer ao cliente.

- Tenha fallback humano: todo chatbot precisa saber quando parar e transferir.

- Teste antes de publicar: simule perguntas comuns, casos extremos e linguagem informal.

- Monitore alucinações: revise respostas incorretas e ajuste prompts ou documentos de apoio.

- Proteja dados: não envie ao modelo mais informações do que o necessário para resolver o caso.

- Meça resultados: acompanhe satisfação, resolução no primeiro contato, tempo médio e custo por atendimento.

Limitações do DeepSeek no atendimento ao cliente

DeepSeek é uma ferramenta poderosa, mas continua sendo IA generativa. Ele pode interpretar mal uma pergunta, responder com excesso de confiança, usar contexto insuficiente ou gerar uma resposta plausível, porém incorreta.

Por isso, evite usar qualquer IA generativa sem revisão humana em:

- decisões jurídicas finais;

- orientações médicas individualizadas;

- aprovação ou recusa automática de crédito;

- cancelamentos complexos com impacto financeiro relevante;

- respostas regulatórias, fiscais ou trabalhistas;

- processamento de dados sensíveis sem base legal e controles adequados.

A melhor abordagem é usar o DeepSeek para acelerar triagem, redação e consulta de conhecimento, mantendo pessoas qualificadas responsáveis por decisões críticas.

Perguntas frequentes

Qual modelo DeepSeek usar no atendimento ao cliente?

Para código novo, use deepseek-v4-flash como padrão em FAQ, triagem, classificação e rascunhos. Use deepseek-v4-pro quando o atendimento exigir raciocínio mais cuidadoso, análise de regras, diagnóstico técnico ou decisões de maior impacto.

Ainda devo usar deepseek-chat ou deepseek-reasoner?

Não como recomendação principal para novas integrações. Esses nomes devem ser tratados como aliases temporários de compatibilidade. Em exemplos novos, prefira deepseek-v4-flash e deepseek-v4-pro.

A API DeepSeek guarda o histórico da conversa?

Não automaticamente. A API /chat/completions é stateless. A aplicação precisa armazenar e reenviar o histórico necessário em cada chamada, respeitando retenção, privacidade e minimização de dados.

DeepSeek pode consultar CRM ou status de pedido?

O modelo pode solicitar uma Tool Call, mas quem consulta o CRM, valida permissão e executa a ação é o backend da aplicação. O modelo não acessa sistemas externos sozinho.

É seguro usar DeepSeek com dados de clientes?

Pode ser usado com controles adequados, mas não deve ser tratado como 100% privado por padrão. Minimize dados, mascare informações quando possível, não envie dados sensíveis sem avaliação legal e técnica, e informe usuários finais sobre o tratamento de dados na sua aplicação.

Esta página deve publicar preços fixos?

Não é recomendável. Preços e regras podem mudar. Para orçamento ou comparação, consulte a página de preços do site e a tabela oficial da DeepSeek no dia da decisão.

Conclusão: como usar DeepSeek para melhorar o suporte

O DeepSeek AI pode melhorar o atendimento ao cliente quando é aplicado com arquitetura correta, fontes confiáveis, controle de dados e revisão humana. Ele é útil para chatbots, e-mails, triagem de tickets, resumo de conversas, análise de sentimento, base de conhecimento e suporte técnico.

Para começar, escolha um caso de uso simples, use deepseek-v4-flash como padrão, reserve deepseek-v4-pro para situações complexas, conecte a IA a documentos aprovados e acompanhe qualidade, latência, escalonamento e custo desde o primeiro teste.

O resultado esperado não é substituir toda a equipe de suporte, mas reduzir repetição, acelerar respostas e permitir que os atendentes humanos dediquem mais tempo aos casos que exigem empatia, julgamento e responsabilidade.

Veja também nosso guia sobre como criar uma aplicação com DeepSeek, a página sobre DeepSeek para empresas no Brasil, a documentação da DeepSeek API em português e a página de segurança.

DeepSeek Português é um guia independente, criado por terceiros, sem afiliação oficial com a DeepSeek, Hangzhou DeepSeek Artificial Intelligence Co., Ltd. ou seus desenvolvedores. Para documentação, preços, políticas e canais oficiais, consulte sempre as páginas oficiais da plataforma.