DeepSeek Thinking Mode é o modo de raciocínio da API DeepSeek que permite ao modelo dedicar parte da geração à análise do problema antes de entregar a resposta final. Ele é útil para tarefas complexas, como código, matemática, debugging, planejamento, agentes com ferramentas e decisões com várias restrições.

Mas ele não deve ser usado em tudo. Para respostas curtas, classificações simples, FAQ básico ou fluxos em que latência e custo por requisição são prioridade, o modo Non-think costuma ser mais adequado.

Atualizado em 4 de maio de 2026, este guia explica como o modo funciona, como ativá-lo na API DeepSeek e como diferenciar Thinking Mode, DeepThink, DeepSeek R1, deepseek-reasoner e os modelos DeepSeek V4. A documentação atual da DeepSeek informa que os modelos deepseek-v4-pro e deepseek-v4-flash suportam modos Thinking e Non-Thinking, além de contexto de 1M tokens.

O que é DeepSeek Thinking Mode?

DeepSeek Thinking Mode é uma forma de fazer o modelo “raciocinar antes de responder”. Em vez de gerar apenas uma resposta direta, o modelo pode produzir uma etapa intermediária de raciocínio e depois entregar o conteúdo final ao usuário.

Na prática, isso ajuda em perguntas que exigem decomposição, comparação, verificação de hipóteses ou análise passo a passo. Por exemplo: revisar uma arquitetura de software, encontrar um bug difícil, planejar um projeto com restrições ou comparar alternativas técnicas.

A diferença principal é esta:

- Responder rápido: o modelo tenta entregar a resposta mais provável com o menor esforço.

- Raciocinar antes de responder: o modelo usa mais tokens e tempo para analisar o problema antes de formular a resposta final.

Isso não significa que o modelo “pensa” como uma pessoa. O termo “thinking” descreve um comportamento de geração orientado a raciocínio, não consciência ou compreensão humana. O resultado pode ser melhor em problemas difíceis, mas ainda precisa de validação em tarefas críticas.

DeepSeek Thinking Mode, DeepThink, R1 e deepseek-reasoner: qual é a diferença?

Muita confusão sobre DeepSeek Thinking Mode vem do uso de nomes parecidos. DeepThink, Pensamento Profundo, R1 e deepseek-reasoner não significam exatamente a mesma coisa.

| Termo | O que significa | Onde aparece | Cuidado importante |

|---|---|---|---|

| DeepSeek Thinking Mode | Modo de raciocínio controlado por parâmetros da API | API DeepSeek, documentação técnica | Não trate como sinônimo automático de R1 |

| DeepThink | Nome usado na experiência de chat para ativar raciocínio mais profundo | Interface web/app da DeepSeek | Pode variar conforme produto e idioma |

| Pensamento Profundo | Tradução comum de DeepThink ou deep thinking | Conteúdos em português, interface ou tutoriais | É um termo descritivo, não necessariamente o nome técnico da API |

| DeepSeek R1 | Modelo de reasoning lançado em 2025, importante historicamente | GitHub, Hugging Face, notícias e documentação antiga | Não é a única forma atual de usar raciocínio na API |

| deepseek-reasoner | Nome de modelo usado para acesso ao reasoning em versões anteriores/compatíveis | API DeepSeek | Está em rota de aposentadoria e atualmente aponta para modo thinking do V4 Flash |

| deepseek-chat | Nome usado para chat sem thinking em versões anteriores/compatíveis | API DeepSeek | Também está em rota de aposentadoria e aponta para V4 Flash non-thinking |

| DeepSeek V4 Pro | Modelo V4 mais forte, indicado para tarefas complexas | API atual, Hugging Face, documentação V4 | Melhor escolha quando qualidade pesa mais que custo/latência |

| DeepSeek V4 Flash | Modelo V4 mais rápido e econômico | API atual, documentação V4 | Boa escolha para escala, automações e tarefas menos exigentes |

Segundo a documentação da DeepSeek, deepseek-chat e deepseek-reasoner serão totalmente aposentados em 24 de julho de 2026, 15:59 UTC. No período de compatibilidade, eles roteiam para modos do deepseek-v4-flash. Por isso, em novos projetos, faz mais sentido usar explicitamente deepseek-v4-pro ou deepseek-v4-flash.

Como o Thinking Mode funciona na prática?

Na API, o Thinking Mode é controlado principalmente por três ideias:

thinking: {"type": "enabled"}ativa o modo de pensamento.reasoning_effortcontrola o nível de esforço de raciocínio.reasoning_contentpode trazer o conteúdo de raciocínio retornado pelo modelo.contentcontém a resposta final destinada ao usuário.

A documentação atual informa que o campo thinking pode ser enabled ou disabled, com enabled como padrão. O parâmetro reasoning_effort aceita high e max; por compatibilidade, low e medium são mapeados para high, enquanto xhigh é mapeado para max.

Também existe um detalhe importante: parâmetros tradicionais como temperature, top_p, presence_penalty e frequency_penalty não controlam o Thinking Mode. A documentação informa que eles podem não gerar erro por compatibilidade, mas não têm efeito nesse modo.

O modelo pode retornar dois tipos de saída:

- Trace de raciocínio: conteúdo intermediário, associado a

reasoning_content. - Resposta final: conteúdo que você normalmente mostra ao usuário, associado a

content.

Em produtos reais, o mais seguro é não exibir o raciocínio bruto automaticamente. Em vez disso, mostre uma resposta final bem estruturada, com resumo de critérios, hipóteses, evidências, limitações e próximos passos.

Como ativar o DeepSeek Thinking Mode na API

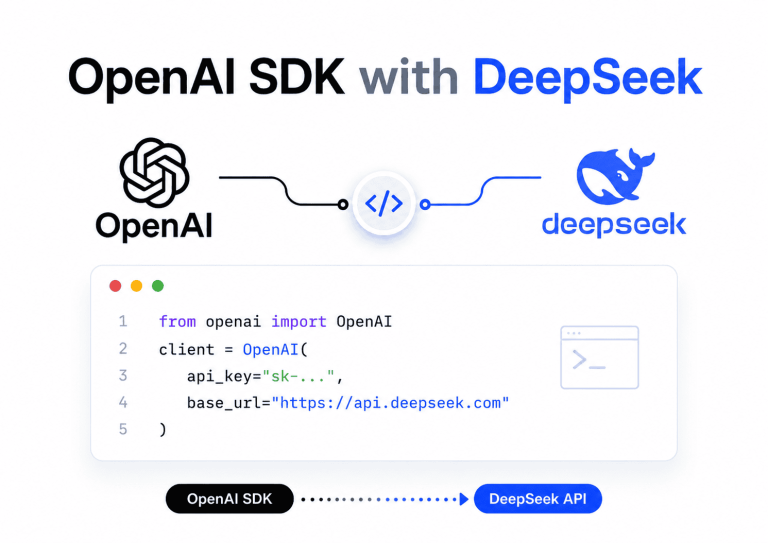

A DeepSeek mantém compatibilidade com o formato OpenAI Chat Completions. Isso permite usar o OpenAI SDK com base_url apontando para a API DeepSeek.

Exemplo em Python com OpenAI SDK

from openai import OpenAI

client = OpenAI(

api_key="DEEPSEEK_API_KEY",

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{

"role": "user",

"content": "Analise os riscos técnicos de migrar este monólito para microsserviços."

}

],

reasoning_effort="high",

extra_body={

"thinking": {"type": "enabled"}

}

)

print(response.choices[0].message.content)Use deepseek-v4-pro quando a tarefa exigir raciocínio mais forte, análise longa ou decisões técnicas com muitas variáveis. Para volume maior e menor custo, teste deepseek-v4-flash.

Exemplo com curl

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-d '{

"model": "deepseek-v4-pro",

"messages": [

{

"role": "user",

"content": "Compare PostgreSQL e MongoDB para um SaaS B2B com relatórios complexos."

}

],

"thinking": {"type": "enabled"},

"reasoning_effort": "high",

"stream": false

}'Como desativar o Thinking Mode

response = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{

"role": "user",

"content": "Resuma este texto em três bullets."

}

],

extra_body={

"thinking": {"type": "disabled"}

}

)

print(response.choices[0].message.content)Desativar o modo de pensamento faz sentido quando a tarefa é simples, repetitiva, sensível a latência ou quando você quer reduzir tokens de saída.

Non-think vs Think High vs Think Max

Os modelos DeepSeek V4 podem operar em modos diferentes. A página oficial do DeepSeek V4 Pro descreve Non-think como rápido para tarefas rotineiras, Think High como mais analítico e Think Max como esforço máximo de raciocínio.

| Modo | Velocidade | Custo provável | Qualidade em tarefas complexas | Melhor uso | Quando evitar |

|---|---|---|---|---|---|

| Non-think | Alta | Menor | Suficiente para tarefas simples | FAQ, resumo curto, classificação, respostas diretas | Problemas ambíguos, código complexo, análise profunda |

| Think High | Média | Médio | Boa para a maioria dos casos complexos | Planejamento, debugging, análise técnica, decisões com critérios | Tarefas triviais ou alto volume de baixa complexidade |

| Think Max | Baixa | Maior | Melhor para problemas muito difíceis | Matemática avançada, arquitetura crítica, agentes complexos, investigação profunda | Uso padrão em produção sem controle de custo |

A regra prática é simples: use Non-think para tarefas simples, Think High como padrão para tarefas complexas e Think Max apenas quando o problema justificar mais tempo e mais tokens.

Quando usar DeepSeek Thinking Mode?

Use DeepSeek Thinking Mode quando a qualidade da análise for mais importante que a velocidade bruta. Ele é especialmente útil quando uma resposta superficial pode gerar retrabalho.

Bons casos de uso incluem:

- Problemas matemáticos: resolução de problemas com várias etapas, comparações numéricas e validação de resultados.

- Análise de código: revisão de pull requests, detecção de bugs, refatoração e explicação de comportamento inesperado.

- Debugging: investigação de causas prováveis, hipóteses, logs e efeitos colaterais.

- Planejamento estratégico: priorização de roadmap, trade-offs, riscos e dependências.

- Agentes com ferramentas: fluxos em que o modelo decide quando chamar funções, APIs ou ferramentas externas.

- Análise de documentos longos: contratos, especificações técnicas, relatórios e documentação extensa.

- Decisões com várias restrições: comparação entre opções considerando custo, prazo, risco, equipe e impacto.

Em todos esses cenários, o modo de raciocínio ajuda o modelo a organizar melhor a resposta final.

Quando NÃO usar Thinking Mode?

Thinking Mode não é uma melhoria universal. Em muitos casos, ele adiciona custo e latência sem ganho relevante.

Evite ativar o modo para:

- respostas curtas;

- FAQ simples;

- classificação rápida;

- geração de textos simples;

- mensagens transacionais;

- tarefas que exigem baixa latência;

- endpoints com grande volume e margem apertada;

- fluxos em que o usuário espera uma resposta instantânea.

Por exemplo, não há motivo para usar Think Max para responder “qual é o status do pedido?” ou “gere cinco variações de título curto”. Nesses casos, Non-think tende a ser mais eficiente.

Custos, tokens e latência: o que muda no modo de pensamento?

O custo do Thinking Mode não vem apenas do preço por token. O ponto principal é que o raciocínio pode gerar mais tokens de saída. Mesmo quando o preço unitário parece baixo, uma resposta com mais raciocínio pode custar mais e demorar mais.

A página de preços da DeepSeek informa que a cobrança é baseada no total de tokens de entrada e saída, e lista deepseek-v4-flash e deepseek-v4-pro com suporte a thinking e non-thinking, contexto de 1M e limite máximo de saída de 384K.

Boas práticas para controlar custo:

- defina limites de tokens por tipo de tarefa;

- registre uso por endpoint, cliente e fluxo;

- teste prompts reais antes de colocar em produção;

- compare Non-think vs Think High em qualidade, custo e latência;

- não use Think Max como padrão;

- crie fallback para respostas simples;

- monitore chamadas com tool calls, pois elas podem gerar várias rodadas.

Para produto, a pergunta não é “qual modo é melhor?”, mas “qual modo entrega qualidade suficiente pelo menor custo aceitável?”.

Tool calls e agentes: cuidado com reasoning_content

O ponto mais delicado do DeepSeek Thinking Mode aparece em agentes com tool calls.

Quando o modelo chama uma ferramenta, a aplicação não deve tratar o modelo como se ele executasse tudo sozinho. O backend é responsável por validar a chamada, executar a ferramenta, coletar o resultado e devolver esse resultado ao modelo.

A documentação de Thinking Mode informa que, quando há tool call, o reasoning_content intermediário do assistant deve participar da concatenação do contexto e ser passado de volta em interações posteriores. Sem isso, alguns fluxos podem gerar erro, inclusive problemas de requisição 400 em integrações que não preservam esse campo.

Checklist para desenvolvedores:

- preserve a mensagem do assistant quando houver tool call;

- não remova

reasoning_contentem fluxos agentic se a documentação exigir ecoar o campo; - valide argumentos de tools no backend;

- nunca execute tool calls sensíveis sem autorização;

- registre logs suficientes para auditoria;

- teste conversas multi-turn, não apenas chamadas isoladas;

- trate erros 400 como possível problema de formato de mensagens.

Um erro comum é construir o histórico apenas com role e content, descartando campos adicionais. Isso pode funcionar em conversas simples, mas quebrar em agentes.

Erros comuns ao usar ou explicar DeepSeek Thinking Mode

| Erro comum | Por que é um problema | Forma correta |

|---|---|---|

| Dizer que Thinking Mode é sempre melhor | Aumenta custo e latência sem necessidade | Use apenas quando a complexidade justificar |

Chamar deepseek-reasoner de “R1 atual” sem contexto | Ignora a evolução da API e dos modelos V4 | Explique que é um nome legado/compatível |

Tentar controlar o modo com temperature | Esses parâmetros não têm efeito no Thinking Mode atual | Use thinking e reasoning_effort |

Ignorar reasoning_content em tool calls | Pode quebrar conversas com ferramentas e gerar erros | Preserve o campo quando houver tool call |

| Mostrar raciocínio bruto ao usuário final | Pode confundir, expor detalhes internos ou criar risco de produto | Mostre resumo, critérios, hipóteses e resposta final |

| Usar Think Max para tudo | Aumenta custo e tempo sem ganho proporcional | Reserve Think Max para tarefas realmente difíceis |

O melhor uso do modo de pensamento combina engenharia de prompt, controle de custo, testes reais e UX clara para o usuário final.

Exemplos de prompts para usar com DeepSeek Thinking Mode

1. Análise de código

Analise o trecho de código abaixo e entregue uma resposta final estruturada com:

1. possível causa do bug;

2. impacto;

3. correção recomendada;

4. teste mínimo para validar.

Não mostre o raciocínio bruto. Mostre apenas a análise final.2. Plano de projeto

Crie um plano de implementação para lançar este recurso em 6 semanas.

Considere equipe pequena, risco técnico, dependências e métricas de sucesso.

Entregue a resposta em fases, com prioridades e riscos.3. Análise de dados

Com base nos dados fornecidos, identifique padrões, anomalias e hipóteses.

Explique as limitações da análise e sugira próximos experimentos.

Entregue apenas a conclusão estruturada.4. Decisão com prós e contras

Compare as opções A, B e C para este cenário.

Use critérios de custo, prazo, risco, manutenção e escalabilidade.

No final, recomende uma opção e explique as condições em que ela mudaria.5. Revisão de arquitetura técnica

Revise esta arquitetura para um SaaS B2B multi-tenant.

Avalie segurança, escalabilidade, observabilidade, custos e pontos únicos de falha.

Entregue recomendações práticas em ordem de prioridade.Esses prompts funcionam melhor porque pedem uma resposta final organizada. Eles não pedem para o modelo expor toda a cadeia de raciocínio.

Boas práticas para produto e segurança

Para usar DeepSeek Thinking Mode em produto, não basta ativar o parâmetro na API. É preciso desenhar o fluxo com segurança, custo e experiência do usuário em mente.

Mostre um resumo do raciocínio, não a cadeia completa. Algo como “critérios considerados”, “principais riscos” e “por que esta recomendação foi escolhida” costuma ser mais útil que um trace longo.

Valide tool calls no backend. O modelo pode sugerir uma chamada de função, mas sua aplicação deve verificar permissões, formato, escopo, limites e segurança antes de executar qualquer ação.

Proteja dados sensíveis. Evite enviar segredos, credenciais, dados pessoais desnecessários ou conteúdo regulado sem controles adequados.

Teste em ambiente controlado. Compare modos, modelos e prompts antes de liberar para produção. Avalie qualidade, custo, latência e taxa de erro.

Documente limites e custos. Times de produto e engenharia precisam saber quando usar Non-think, Think High e Think Max.

Revise respostas em tarefas críticas. Para jurídico, saúde, segurança, finanças, infraestrutura e decisões de alto impacto, o modelo deve apoiar a análise, não substituir revisão humana qualificada.

FAQ sobre DeepSeek Thinking Mode

O que é DeepSeek Thinking Mode?

DeepSeek Thinking Mode é o modo de raciocínio da API DeepSeek. Ele permite que o modelo dedique mais processamento e tokens à análise antes de gerar a resposta final.

DeepSeek Thinking Mode é o mesmo que DeepThink?

Não exatamente. DeepThink costuma aparecer como nome de experiência na interface de chat, enquanto Thinking Mode é o termo técnico usado no contexto da API.

Thinking Mode é o mesmo que DeepSeek R1?

Não. DeepSeek R1 é um modelo de reasoning lançado em 2025 e importante historicamente. Thinking Mode é um modo de uso atual da API, especialmente relevante nos modelos DeepSeek V4.

O que é reasoning_content?

reasoning_content é o campo que pode trazer o conteúdo de raciocínio gerado pelo modelo em Thinking Mode. Em produtos finais, normalmente é melhor exibir um resumo do raciocínio, não o conteúdo bruto.

O que é reasoning_effort?

reasoning_effort controla o esforço de raciocínio. Na API atual, os valores principais são high e max.

Posso usar temperature no Thinking Mode?

Segundo a documentação atual da DeepSeek, parâmetros como temperature, top_p, presence_penalty e frequency_penalty não têm efeito no Thinking Mode.

Thinking Mode custa mais?

Pode custar mais porque tende a gerar mais tokens de saída e pode aumentar a latência. O preço por token é apenas uma parte do cálculo.

Quando devo usar Think Max?

Use Think Max apenas para problemas muito complexos, como raciocínio matemático difícil, arquitetura crítica, agentes complexos ou análise em que a qualidade justifique mais custo e tempo.

Posso usar tool calls no Thinking Mode?

Sim, mas é preciso cuidado. Em fluxos com tool calls, o backend executa as ferramentas e o histórico deve preservar os campos exigidos pela API, incluindo reasoning_content quando necessário.

Qual modelo usar: deepseek-v4-pro ou deepseek-v4-flash?

Use deepseek-v4-pro para tarefas complexas em que qualidade é prioridade. Use deepseek-v4-flash para custo menor, maior velocidade e volume de requisições.

Conclusão

DeepSeek Thinking Mode é uma ferramenta poderosa quando a tarefa exige raciocínio real: programação complexa, debugging, matemática, planejamento, análise de documentos, agentes com ferramentas e decisões com múltiplas restrições.

A recomendação prática é simples: use Non-think para tarefas simples, Think High como padrão para tarefas complexas e Think Max apenas quando o problema justificar o custo e a latência adicionais.

Para novos projetos, prefira deepseek-v4-pro ou deepseek-v4-flash, em vez de depender de nomes legados como deepseek-chat e deepseek-reasoner. E acompanhe sempre a documentação oficial da DeepSeek, porque nomes de modelos, parâmetros e comportamento da API podem mudar com o tempo.