Na API oficial atual, os IDs deepseek-chat e deepseek-reasoner correspondem ao DeepSeek-V3.2 com contexto de 128K tokens. Portanto, exemplos com esses IDs nesta página não representam uma chamada direta ao DeepSeek R1 histórico. Aqui, o R1 é tratado como modelo/open-weight histórico, útil para estudo técnico, comparação de benchmarks, pesquisa e self-hosting.

O DeepSeek R1 foi apresentado pela DeepSeek em janeiro de 2025 como uma geração de modelos focada em raciocínio avançado. Dentro do ecossistema DeepSeek, ele é melhor entendido hoje como um marco técnico da fase inicial de modelos reasoning-first: importante para compreender cadeia de pensamento, aprendizado por reforço em larga escala, benchmarks de matemática/código e a abertura de pesos e modelos destilados.

Essa distinção editorial importa porque muitos textos antigos misturam duas coisas diferentes: o DeepSeek R1 histórico e o reasoner atual da API. Em 2026, o reasoner público é um modo thinking do DeepSeek-V3.2. Já o R1 propriamente dito continua relevante como objeto de estudo, comparação histórica e execução própria em ambientes adequados.

Resumo rápido: como interpretar o DeepSeek R1 hoje

| Item | Status correto em 2026 |

|---|---|

| Natureza da página | Arquivo histórico e guia técnico sobre o DeepSeek R1. |

| O que foi o R1 | Primeira geração de modelos DeepSeek voltada explicitamente para raciocínio avançado, incluindo R1-Zero, R1 e variantes destiladas. |

| API oficial atual | deepseek-reasoner e deepseek-chat correspondem ao DeepSeek-V3.2, não a um endpoint público dedicado ao R1. |

| Onde o R1 faz sentido hoje | Pesquisa, benchmark histórico, entendimento de RL para raciocínio, open-weight/self-hosting e comparação com gerações posteriores. |

| Pesos e variantes | Disponíveis em repositórios oficiais como Hugging Face, incluindo modelos Distill em múltiplos tamanhos. |

| Recomendação editorial | Apresente o R1 como geração histórica/técnica; direcione integrações atuais para V3.2, preços e documentação oficial. |

O que foi o DeepSeek R1?

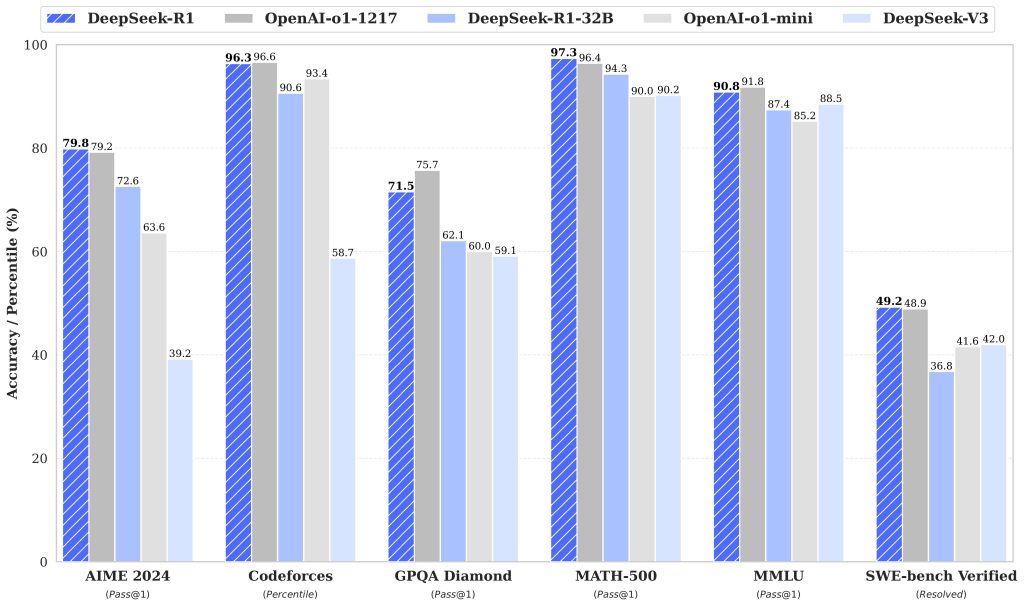

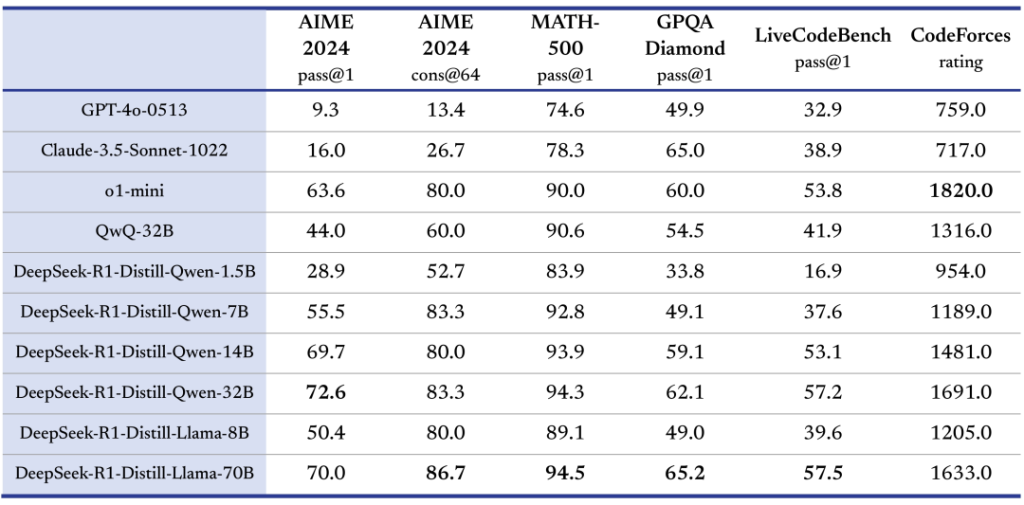

O DeepSeek R1 surgiu como parte da primeira geração de modelos de raciocínio da DeepSeek. A família foi apresentada com duas referências centrais: DeepSeek-R1-Zero e DeepSeek-R1. Segundo o model card oficial, o R1-Zero foi treinado com aprendizado por reforço em larga escala sem supervised fine-tuning prévio, revelando comportamentos emergentes como auto-verificação, reflexão e cadeias de raciocínio longas. Ao mesmo tempo, o R1-Zero sofria com problemas práticos de repetição, legibilidade e mistura de idiomas.

Para corrigir essas limitações, o DeepSeek-R1 incorporou cold-start data antes do RL e passou a usar um pipeline com duas etapas de RL e duas etapas de SFT. Na prática, isso colocou o modelo em uma posição de destaque histórico: forte em matemática, código e tarefas de raciocínio multi-step, com desempenho descrito oficialmente como comparável ao OpenAI-o1 em várias avaliações da época.

Especificações técnicas principais

| Aspecto | Resumo técnico |

|---|---|

| Base do modelo | DeepSeek-V3-Base. |

| Parâmetros totais | 671 bilhões. |

| Parâmetros ativados | 37 bilhões por inferência/token. |

| Contexto | 128K tokens. |

| Foco | Raciocínio, matemática, programação e problemas multi-step. |

| Família | DeepSeek-R1-Zero, DeepSeek-R1 e modelos Distill baseados em Qwen e Llama. |

| Execução local | O R1 completo exige infraestrutura mais sofisticada; os modelos Distill são o caminho prático para experimentação local. |

Além do modelo principal, a DeepSeek também publicou seis modelos destilados, incluindo variantes baseadas em Qwen e Llama. No model card oficial aparecem, entre outras, as seguintes versões: 1.5B, 7B, 8B, 14B, 32B e 70B. Isso tornou o R1 especialmente relevante para a comunidade open-source, porque permitiu levar parte do comportamento reasoning-first a ambientes muito mais viáveis do ponto de vista de hardware.

Linha do tempo resumida

| Data | Evento | Como isso afeta esta página |

|---|---|---|

| 20 de janeiro de 2025 | Lançamento oficial do DeepSeek-R1. | O R1 entra no ecossistema como modelo reasoning-first aberto, com relatório técnico e versões destiladas. |

| 28 de maio de 2025 | Lançamento do DeepSeek-R1-0528. | A versão R1-0528 melhora benchmarks, reduz alucinações e adiciona JSON output e function calling. |

| 21 de agosto de 2025 | deepseek-chat e deepseek-reasoner passam a servir o DeepSeek-V3.1. | A API pública deixa de ter o R1 como camada principal. |

| 22 de setembro de 2025 | Atualização para V3.1-Terminus. | O foco operacional da API continua migrando para gerações posteriores. |

| 29 de setembro de 2025 | Atualização para V3.2-Exp. | O reasoner público já não deve ser chamado de “R1 atual”. |

| 1 de dezembro de 2025 | Atualização para DeepSeek-V3.2. | deepseek-chat e deepseek-reasoner passam a ser documentados como modos do V3.2. |

| 17 de abril de 2026 | Estado editorial desta página. | O DeepSeek R1 é tratado aqui como geração histórica/técnica; integrações atuais devem começar por V3.2. |

R1, R1-0528 e o reasoner atual: diferença editorial crítica

Este é o ponto mais importante para evitar contradições com outras páginas do site. O nome DeepSeek R1 se refere à geração histórica/open-weight lançada em 2025. Já o identificador deepseek-reasoner na documentação da API atual se refere ao modo thinking do DeepSeek-V3.2. Entre esses dois momentos houve uma transição clara, registrada no changelog oficial da DeepSeek.

| Termo | Interpretação correta | Evite escrever assim |

|---|---|---|

| DeepSeek R1 | Modelo reasoning-first histórico/open-weight lançado em janeiro de 2025. | “o endpoint atual da API”. |

| DeepSeek-R1-0528 | Atualização histórica do R1, publicada em maio de 2025, com melhorias de benchmark e front-end. | “o modelo principal atual da DeepSeek”. |

deepseek-reasoner | Modo thinking do DeepSeek-V3.2 na API atual. | “endpoint público dedicado ao R1”. |

deepseek-chat | Modo non-thinking do DeepSeek-V3.2 na API atual. | “o mesmo que V3 histórico” ou “o mesmo que R1”. |

GET /models | Forma correta de verificar quais modelos estão disponíveis no momento. | Assumir que o R1 continua listado como principal por padrão. |

Também vale uma nota prática: no modo thinking atual, a API retorna o campo reasoning_content separado do content. O max_tokens inclui a cadeia de raciocínio, e o fluxo com ferramentas em thinking mode pode exigir o reenvio do reasoning_content dentro do mesmo subfluxo de ferramenta. Essas características pertencem à API atual e não devem ser usadas como prova de que o endpoint público continua sendo o R1 histórico.

Exemplo correto da API atual para quem quer comparar com o R1

O exemplo abaixo é útil para leitores desta página que buscam uma experiência de raciocínio semelhante hoje pela API oficial. Ele não chama o R1 histórico; chama o deepseek-reasoner atual, que a documentação oficial associa ao DeepSeek-V3.2.

from openai import OpenAI

client = OpenAI(

api_key="<DEEPSEEK_API_KEY>",

base_url="https://api.deepseek.com"

)

messages = [

{"role": "user", "content": "9.11 and 9.8, which is greater?"}

]

response = client.chat.completions.create(

model="deepseek-reasoner",

messages=messages

)

reasoning_content = response.choices[0].message.reasoning_content

content = response.choices[0].message.content

print(reasoning_content)

print(content)

Se a sua necessidade é integração moderna em produção, pare nesta camada e siga para DeepSeek V3.2, Preços do DeepSeek e FAQ. Se o seu objetivo é estudar o R1 em si, faz mais sentido consultar os pesos, o model card e os materiais técnicos históricos.

Como estudar ou executar o R1 hoje

Em 2026, existem dois caminhos práticos para quem cai nesta página:

- Quero raciocínio via API oficial: use o

deepseek-reasoneratual e trate-o como modo thinking do V3.2. - Quero estudar o R1 histórico/open-weight: use os repositórios oficiais do R1, do R1-0528 ou de modelos Distill para pesquisa, experimentação e self-hosting.

O model card do Hugging Face afirma que o R1 completo exige fluxo de execução mais especializado e remete ao repositório do DeepSeek-V3 para instruções detalhadas. Já os modelos Distill podem ser usados mais facilmente com ferramentas como vLLM e SGLang. Um exemplo direto do próprio model card:

vllm serve deepseek-ai/DeepSeek-R1-Distill-Qwen-32B \

--tensor-parallel-size 2 \

--max-model-len 32768 \

--enforce-eager

Para a maior parte dos desenvolvedores, os modelos DeepSeek-R1-Distill são a forma mais realista de experimentar a família R1 localmente. Eles preservam parte importante do comportamento reasoning-first, mas com custos de hardware muito menores que os do modelo full 671B.

Licença e abertura

Outro motivo para o R1 continuar relevante é o seu posicionamento aberto. O release oficial destacou que o modelo completo e o relatório técnico foram abertos, e o model card atual no Hugging Face afirma que o repositório de código e os pesos da série DeepSeek-R1 estão sob licença MIT. Isso inclui suporte a uso comercial, modificações e trabalhos derivados.

Mesmo assim, vale uma nuance técnica importante: as variantes DeepSeek-R1-Distill-Qwen derivam da família Qwen 2.5 e preservam a base licenciada sob Apache 2.0; as variantes DeepSeek-R1-Distill-Llama derivam de modelos Llama e continuam sujeitas às licenças correspondentes dessas bases. Em outras palavras, a página pode afirmar com segurança que a família R1 é aberta e amigável para experimentação/comercialização, mas deve sempre lembrar que as variantes distiladas carregam heranças de licença do modelo-base.

Boas práticas ao trabalhar com variantes R1

Se a proposta desta página é ser técnica, vale registrar as recomendações do próprio model card da família R1 para uso local e benchmarking:

- Temperatura: manter entre

0.5e0.7, com0.6como valor recomendado. - Prompt de sistema: evitar quando possível; o material oficial recomenda concentrar as instruções no prompt do usuário.

- Matemática: pedir explicitamente raciocínio passo a passo e resposta final bem delimitada.

- Padrão de pensamento: em certas consultas, a série R1 pode “pular” o padrão de reflexão; em experimentos locais, o material oficial sugere forçar o início com

<think>\nquando necessário. - Infraestrutura: planejar com realismo. O modelo completo 671B é muito mais exigente do que as variantes destiladas.

Quando esta página ajuda — e quando não ajuda

| Esta página ajuda quando você quer… | Esta página não é a melhor porta de entrada quando você quer… |

|---|---|

| Entender o papel histórico do R1 dentro da evolução da DeepSeek. | Escolher o endpoint atual da API para produção. |

| Estudar RL, cadeia de raciocínio, benchmarks históricos e modelos Distill. | Consultar preços atualizados ou disponibilidade atual de modelos. |

| Comparar R1, R1-0528, V3.1 e V3.2 dentro de uma linha do tempo coerente. | Tratar deepseek-reasoner como se ainda fosse um endpoint público dedicado ao R1. |

| Planejar self-hosting e experimentação open-weight. | Usar imagens históricas de benchmark como garantia de performance no seu caso real. |

Conclusão

O DeepSeek R1 continua sendo uma peça central da história técnica da DeepSeek: ele consolidou a discussão sobre raciocínio explícito, RL em larga escala, abertura de pesos e modelos destilados com foco em matemática, código e lógica. Mas, editorialmente, o passo correto em 2026 é tratá-lo como geração histórica/técnica, não como a camada principal atual da API pública.

Se você está aqui para entender a evolução do ecossistema, o R1 merece estudo. Se você quer integrar DeepSeek em produção agora, comece por DeepSeek V3.2, confira os preços, revise a FAQ e mantenha em mente as páginas de Segurança, Privacidade e Aviso Legal. Esse arranjo reduz ambiguidade, melhora a coerência interna do site e faz com que a página do R1 trabalhe a favor da página principal — sem competir com ela nem contradizer o estado atual da DeepSeek.